随着大模型训练、跨境电商推荐系统、AI视频生成等应用爆发式增长,美国GPU服务器租用成为众多企业布局海外算力的核心方案。尤其是在模型训练合规性、海外数据访问速度以及全球用户覆盖等因素影响下,美国GPU服务器逐渐成为企业技术架构中的重要一环。然而,不同服务商报价差距明显,同类显卡租用价格甚至相差数倍,背后原因值得深入分析。

美国GPU服务器租用为何成为热门选择

从技术生态来看,美国拥有成熟的数据中心基础设施和稳定的网络带宽资源。硅谷及弗吉尼亚等区域聚集大量Tier 3以上机房,电力冗余和网络冗余标准高,适合长时间高负载训练任务。

同时,主流GPU型号首发及库存往往优先供应美国市场。例如NVIDIA A100、H100、L40S等型号在美国节点的可用率更高,对于需要大规模并行训练的团队而言,部署周期明显更短。

- 跨境业务访问北美与欧洲用户延迟更低

- 主流AI框架环境兼容性成熟

- 带宽成本相对稳定,支持大规模数据传输

价格差距背后的三大核心因素

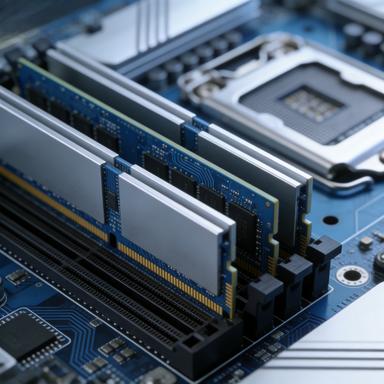

1. 显卡型号与算力等级差异

同样是美国GPU服务器租用,A100 80GB与H100 80GB在算力性能上存在代际差距,训练效率可能提升30%以上,但租用成本也显著提高。部分入门级方案使用RTX 4090或A6000,适合中小规模推理部署,价格自然更具优势。

2. 带宽与线路质量

高端机房通常配备多线BGP或直连骨干网络,保障跨洲访问稳定性。部分低价方案采用共享带宽或限速模式,适合测试环境,却不适合商业级部署。

3. 资源独享与虚拟化方式

独享整机与虚拟GPU在价格结构上差异明显。独享服务器适合长期训练任务,稳定性更高;而vGPU方案更适合阶段性推理需求或开发测试环境。企业在选择时需结合业务周期进行规划。

不同应用场景下的配置建议

针对不同业务阶段,算力结构应合理匹配,而非一味追求高规格。

- 大模型训练:建议选择8卡A100或H100服务器,配备高速NVMe存储和100Gbps以上内网带宽

- AI推理部署:可采用单卡L40S或A10方案,控制成本同时保证响应速度

- 视频生成与渲染:注重显存容量与CUDA核心数量,避免显存瓶颈

- 跨境电商推荐系统:强调网络稳定性与数据安全策略

此外,越来越多企业关注GPU服务器能效比与长期成本。按月租用虽灵活,但若训练周期超过6个月,年付或包段采购往往更具性价比。

企业在选择服务商时应关注哪些指标

美国GPU服务器租用不仅仅是硬件选择,更涉及整体运维能力。建议重点评估以下维度:

- 机房等级与SLA保障条款

- 是否支持弹性扩容与快速交付

- 是否提供技术支持与系统预装服务

- 数据合规与隐私保护机制

当前AI行业竞争激烈,算力已成为核心生产资料。稳定、高性能的美国GPU服务器能够缩短模型训练周期,提高产品上线速度,从而在市场竞争中获得先机。

结论

美国GPU服务器租用的价格差距并非简单的市场波动,而是由显卡代际、带宽质量、资源独享程度以及服务能力共同决定。企业在规划海外算力时,应从业务目标、预算周期与技术路线出发,构建合理的算力架构。选择适配自身发展的GPU方案,远比单纯追求低价更具战略价值。